STATYSTYKA 08.03.2009 rok IPSiR

Analiza współzależności zmiennych mierzalnych

Korelacja i regresja

Część I

Celem analizy współzależności jest badanie związków między zmiennymi i prognozowanie jednych zmiennych za pomocą innych zmiennych i ich wzajemnych związków.

Analiza współzależności między zmiennymi to badanie zbiorowości statystycznej ze względu na dwie lub więcej zmiennych jednocześnie. Zakładamy, że wszystkie zmienne są mierzalne.

Warto podkreślić, że terminy współzależność lub współwystępowanie są tu bardzo zasadne. Należy wyraźnie odróżniać współzależność od zależności, która kojarzy się z zależnością przyczynowo-skutkową. Statystyka koncentruje się na badaniu liczbowym związku między zmiennymi, natomiast natura związku, jej przyczynowo-skutkowy charakter należy ustalać w oparciu o wiedzę, teorię w danej dziedzinie wiedzy socjologii, psychologii, kryminologii itp.

Umownie, dla ułatwienia będziemy mówić o zmiennej Y - zależna, a o zmiennej X jako niezależna, ale nie w rozumieniu zależności przyczynowo-skutkowej. Lepszym, „zgrabniejszym” określeniem dla zmiennej Y jest - zmienna objaśniana, a dla zmiennej X - objaśniająca.

Korelacja pozorna - oznacza przypadkowe współwystępowanie zmiennych Y i X, które nie ma potwierdzenia w naturze związku. Przykład: Y - liczba urodzeń i X - liczba przylatujących bocianów. W interpretacjach związków należy uważać, aby nie wpaść w pułapkę korelacji pozornych.

Statystyczny model współzależności zmiennych Y i X przedstawiamy jako:

Y= f (X, e)

gdzie:

Y - zmienna objaśniana,

X - zmienna objaśniająca,

e - składnik losowy, który reprezentuje wpływ na Y innych zmiennych, nie uwzględnionych w modelu, oraz inne czynniki wpływające na Y, w tym czynniki losowe.

Y - może być np. wynik testu z logiki ( musi być mierzalne)

W ogólnym podejściu możemy przyjąć, że zmienna Y (objaśniająca) jest współzależna z wieloma zmiennymi objaśniającymi: X1, X2, ….Xk, co możemy zapisać jako:

Y= f (X1, X2, …., Xk, e)

Uwzględnienie wielu zmiennych jest domeną analizy wielowymiarowej, w której obserwujemy wpływ zmiennych objaśniających na zmienną objaśnianą, a także wzajemną zależność zmiennych objaśniających.

Związki statystyczne i matematyczne

Funkcja matematyczna („związek matematyczny”) jest to jednoznaczne przyporządkowanie wartościom jednego zbioru wartości drugiego zbioru [według pewnego przepisu f].

Np. y=2x+4 (funkcja liniowa) oznacza, że gdy x=4 to y=12, a gdy x=10 to y=24.

Współzależność statystyczna dotyczy zmiennych empirycznych i związku empirycznego. Nie są to nigdy związki jednoznaczne.

W analizie związków empirycznych (statystycznych) wskazujemy na prawidłowości współwystępowania zmiennych np. Y i X (przeciętny trend) oraz rozbieżności od prawidłowości (rozrzut punktów empirycznych).

Współwystępowanie tych dwóch zmiennych Y i X przedstawiamy na wykresie zwanym diagramem korelacyjnym, w którym na osi odciętych (X - poziomej) przedstawiamy zmienną „niezależną”, a na osi rzędnych (Y - pionowej) zmienną „zależną”.

Przykład 1. Związek między dwiema zmiennymi: Y - szybkość czytania i X - iloraz inteligencji (IQ):

Diagram korelacyjny:

Elementy korelacji i regresji

Korelacja

Mówi o tym jaki jest kierunek związku Y i X

Mówi o tym jaka jest siła związku Y i X

Warto podkreślić, że siła związku jest domeną wyłącznie związków statystycznych. Ta charakterystyka nie występuję w przypadku związków matematycznych, które są jednoznaczne.

Regresja

Mówi o tym jaki jest kierunek związku

Mówi o tym jaki jest kształt

Kierunek związku może być dodatni lub ujemny.

Związek między Y i X jest dodatni, jeśli rosnącym wartością zmiennej X odpowiadają rosnące wartości zmiennej Y.

Związek między Y i X jest ujemny jeśli rosnącym wartością zmiennej X odpowiadają malejące wartości zmiennej Y.

Siła współzależności może być duża i mała.

Jeśli punkty skupione są np. blisko linii - oznacza to silną współzależność. Jeśli punkty empiryczne są bardzo rozproszone - związek określamy jako słaby.

Przykład związku silnego:

Przykład związku słabego:

Kształt związku: współzależność może mieć kształt liniowy lub nieliniowy (logarytmiczny, wykładniczy itp.).

Współczynnik korelacji liniowej Pearsona

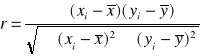

Do określenia siły korelacji stosuje się współczynnik korelacji liniowej Pearsona r, który oblicza się według wzoru:

Współczynnik korelacji Pearsona mierzy siłę zależności tylko w przypadku współzależności liniowej.

Właściwości współczynnika r Pearsona.

1. Współczynnik r przyjmuje wartości od -1 do +1,

czyli: -1 ≤ r ≤ 1

2. Wartość współczynnika korelacji określa siłę i kierunek współzależności

a) moduł r (IrI) - określa siłę współzależności

b) znak (+ -) - określa kierunek związku

3. Interpretacja przykładowych wartości współczynnika:

r=0: brak związku między zmiennymi YX

r= -1 lub r=+1: związek funkcyjny („najsilniejszy”)

IrI bliskie 1: związek między YX silny

IrI bliskie 0: związek słaby

4. Współczynnik korelacji r Pearsona ma własność symetryczności,

czyli: ryx = rxy

oznacza to, że siła zależności między Y i X jest taka sama jak między X i Y.

5. Kwadrat r (r2) określa się mianem współczynnika determinacji i oznacza % zmienności Y wyjaśniony zmiennością X.

Np. r2=0,67 oznacza, że zróżnicowanie Y można w 67% wyjaśnić zróżnicowaniem X.

Przykład 1. [jest trochę zmieniony w porównaniu z tym na zajęciach]

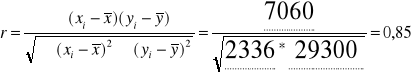

Obliczyć współczynnik korelacji między Y i X (Y - szybkość czytania i X - iloraz inteligencji (IQ).

lp |

xi |

yi |

xi - |

yi - |

(xi - |

(xi - |

( yi - |

1 |

80 |

120 |

-27 |

-55 |

1485 |

729 |

3025 |

2 |

92 |

140 |

-15 |

-35 |

525 |

225 |

1225 |

3 |

90 |

100 |

-17 |

-75 |

1275 |

289 |

5625 |

4 |

109 |

170 |

2 |

-5 |

-10 |

4 |

25 |

5 |

100 |

130 |

-7 |

-45 |

315 |

49 |

2025 |

6 |

105 |

190 |

-2 |

15 |

-30 |

4 |

225 |

7 |

110 |

220 |

3 |

45 |

135 |

9 |

2025 |

8 |

110 |

140 |

3 |

-35 |

-105 |

9 |

1225 |

9 |

115 |

180 |

8 |

5 |

40 |

64 |

25 |

10 |

120 |

240 |

13 |

65 |

845 |

169 |

4225 |

11 |

123 |

200 |

16 |

25 |

400 |

256 |

625 |

12 |

130 |

270 |

23 |

95 |

2185 |

529 |

9025 |

Suma

|

1284 |

2100 |

X |

X |

7060 |

2336 |

29300 |

Średnia X= 107

Średnia Y= 175

r2 = 0,73

Interpretacja:

Związek między Y i X jest silny i dodatni, co oznacza, że osoby o wyższym IQ szybciej czytają. Współczynnik determinacji 0,73 oznacza, że zróżnicowanie szybkości czytania można w 73% wyjaśnić zróżnicowaniem IQ.

Wyszukiwarka

Podobne podstrony:

Statystyka #9 Regresja i korelacja

zadanie 2- regresja liniowa, Statyst. zadania

06.regresja liniowa, STATYSTYKA

Badanie jakości związku regresyjnego, matematyka, Matematyka. Prawdopodobienstwo i Statystyka

Analiza regresji, Statystyka - ćwiczenia - Rumiana Górska

Statystyka matematyczna, 4-część, Analiza regresyjna

statystya wyznaczanie, WYZNACZANIE PROSTEJ REGRESJI I PROSTEJ TRENDU W ARKUSZU EXCEL

modele regresji SGH metody statystyczne 2008

Analiza regresji między dwiema zmiennymi, Płyta farmacja Bydgoszcz, statystyka, pozostałe

regresje i zaleĹĽnosci statystyczne, Twierdzenia statystyczne dotycz˙ce zale˙no˙ci mi˙dzy zmienymi s

statystyka, Korelacja i regresja liniowa, Korelacja i regresja liniowa

statystyka ćw, regresja - zadania Zarz+Soc, Zadanie 2

Analiza korelacji i regresji 3, STATYSTYKA (WYK?AD 16

Analiza korelacji i regresji 3, STATYSTYKA (WYK?AD 16

Analiza regresji między dwiema zmiennymi, Statystyka, statystyka(3)

Statystyka i demografia Regresja liniowa 2011 2012 Kubiczek

więcej podobnych podstron